Apple stelt CSAM-detectie uit na ophef

In een verklaring op haar website laat Apple weten dat CSAM-detectie geen onderdeel zal zijn van de grote release van iOS 15. Deze aankondiging komt niet geheel onverwacht: veiligheidsexperts en critici van over de hele wereld uitten hun zorgen over de functie, waaronder ook klokkenluider Edward Snowden.

Apple zegt dat het de beslissing baseert op feedback van klanten, belangenbehartigers, onderzoekers en anderen. Het bedrijf laat niet weten wanneer de release zal zijn van CSAM, maar geeft aan dat ze de komende maanden gebruiken voor het verbeteren van de functie. Dit is de verklaring van Apple:

“Update op 3 september 2021: We kondigden vorige maand plannen aan, bedoeld om kinderen te beschermen tegen misbruikers die communicatiemiddelen gebruiken om kinderen te lokken en exploiteren en om de verspreiding van seksueel getint beeldmateriaal van kinderen te beperken. Naar aanleiding van feedback van klanten, belangenbehartigers, onderzoekers en anderen, hebben we besloten om de komende maanden meer tijd te nemen om feedback te verzamelen en verbeteringen te maken voordat we deze zeer belangrijke functie voor kinderveiligheid uitrollen.”

Je kunt de Engelstalige verklaring bekijken op de website van Apple.

Al langer ophef om CSAM

Er was al bij de aankondiging veel ophef omtrent de CSAM functie. Het was niet de intentie van Apple die in het verkeerde keelgat schoot. De mogelijkheid om kindermisbruik te detecteren in foto’s zou volgens experts slechts het begin kunnen zijn. Apple paste de techniek al toe in iCloud Mail en wilde het nu uitbreiden naar iCloud Foto’s.

In een interview met Craig Federighi werd al duidelijk dat Apple inzag niet de beste beslissing te hebben genomen op het gebied van communicatie. Federighi legde op beeld nog eens uit hoe CSAM moet werken en waarom Apple het een veilig systeem acht.

Het is nog helemaal onduidelijk in welke iOS-versie we CSAM kunnen verwachten. Hoewel we de kans zeer klein achten, bestaat ook de mogelijkheid dat Apple de functie schrapt tot nader order. Apple is lastig te voorspellen als het bedrijf slechts meldt dat het om “maanden” gaat.

Artikelcorrectie, spelfout of -aanvulling doorgeven?

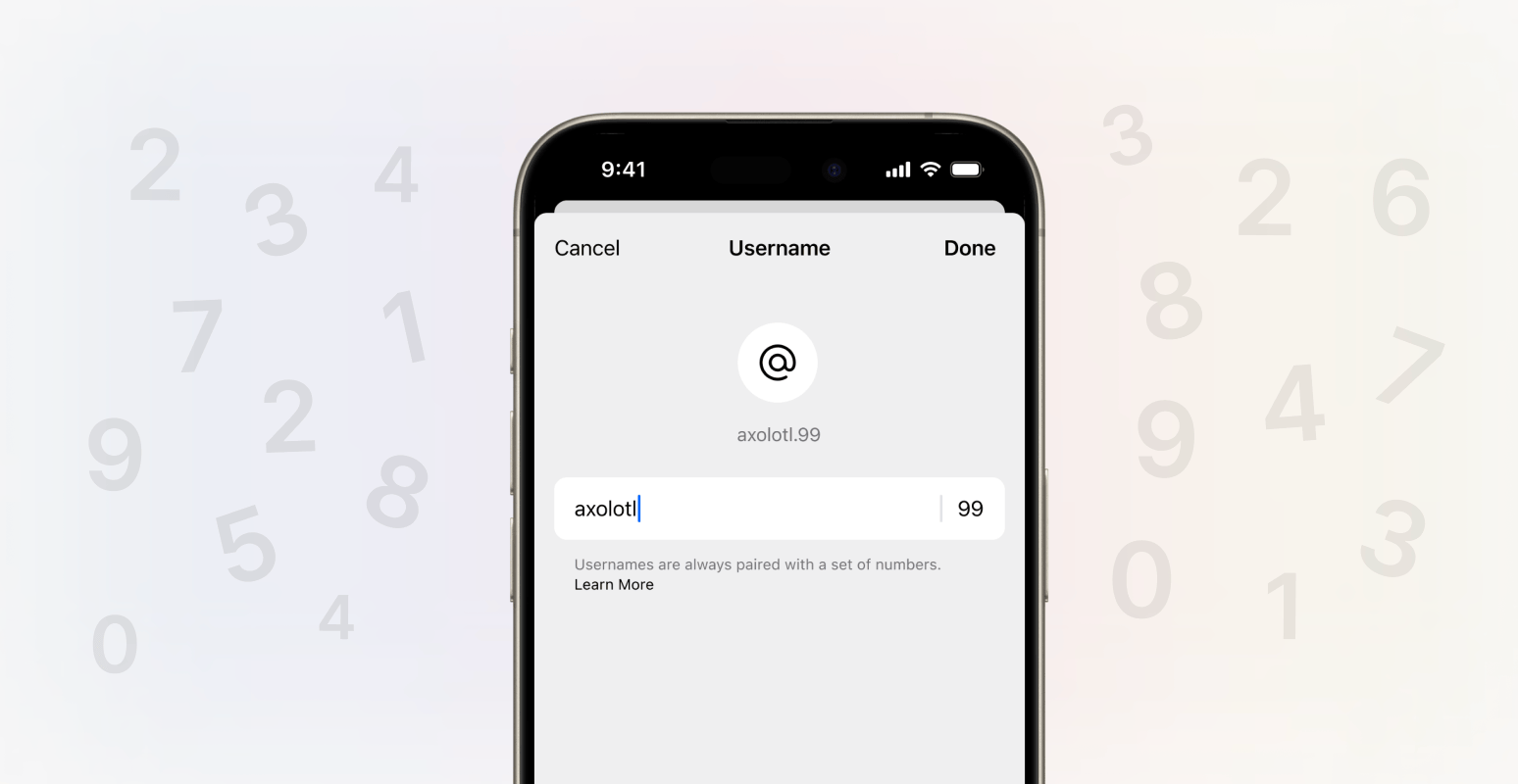

De iPhone en iPad voor kinderen

13 reacties

Rik

Uitstel is niet genoeg. Apple had er überhaupt nooit aan moeten denken om een dergelijke feature toe te voegen, gaat volledig in tegen de (oorspronkelijke) waarde die ze aan privacy hechten.

Victor

Fijn, al zou de functie wat mij betreft geheel achterwege mogen blijven. Ik snap niet wat de (commerciële) gedachte hier achter is. Zoals velen krijg ik hier juist “facebook” achtige gedachten bij en dat is verre van positief.

Chris

Wat ik niet begrijp is hoe dit voor extra klanten kan zorgen. “Ik ben geen kinderlokker maar laat ik maar Apple kopen want dan worden mijn foto’s tenminste gescand”. Of “hmm ik ben kinderlokker maar ik wil ook een Apple. Ik koop m lekker toch!” . Beide lijkt mij niet aantrekkelijk.

Iphonefan123

Heel verstandig…..

Zeer zeer slechte ontwikkeling dit.

Deze techniek kan ook voor andere doeleinden gebruikt worden.

Zal me niets verbazen als de chinese overheid hierom staat te springen.

Jaap Couro

Na de gigantische, terechte, kritiek neem dus zelfs Apple (normaliter ongevoelig voor kritiek) een time-out. Zo lang ze daar vasthouden aan de optie toch een trojan-spy framework op de toestellen te plaatsen, zal er aan de kritiek niks veranderen. Uitstel is een goede stap, zolang de volgende stap afstel gaat zijn. Een telefoon die op basis van “neuro” hashes uit vage databases politieagent op de telefoon gaat spelen buiten zicht van de gebruiker. Welke bizarre gedachtegang daar bij Apple momenteel leeft… het is iig niet meer de zogenaamde privacy beschermer.

HB

Hopelijk komt van uitstel afstel!

Roy Senden

Ik had dit in een reactie op het allereerste nieuws al voorspeld. Apple gaat dit nooit doen. Dit is een marketing methode om achteraf te kunnen zeggen “kijk eens hoe hoog wij privacy hebben zitten”. Als sneer naar Google toe. Die scanner gaat er nooit komen en de hele discussie die aangezwengeld is, is een vooropgezet plan. De eerste indicatie dat het nooit serieus is geweest zit hem in het feit dat de aankondiging niet op de WWDC werd gedaan omdat Apple echt wel wist dat dit de aandacht van de serieuze aankondigingen zou wegtrekken. Ga er maar van uit; van uitstel komt afstel.

Mike

Dit is voor mij een reden om af te stappen van iPhone.

Helaas want ik ben een groot fan 🙁

Swen

@Mike: Want? Scannen gebeurt nu ook bij alle clouddiensten maar dan in de cloud, Apple wilde het lokaal maken op iPhones zonder tussenkomst van internet, enkel bij dus kinderporno zou er een seintje gegeven worden. Eigenlijk is de nieuwe manier beter want ze scannen niet meer in de cloud maar met een lokaal stukje software op je telefoon. Eigenlijk is er ophef om niks maar is dit slapende honden wakker maken gezien dit dus wel al gebeurt enkel de locatie zou gewijzigd worden.

hans

@Swen: Iets verder nadenken Swen want met deze software op je toestel zelf zet Apple de deur open om ook andere zaken op je toestel te kunnen doorzoeken, als dat zo uitkomt. Bovendien is het niet de taak van een techbedrijf om zich hiermee bezig te houden. Jij koopt een duur toestel en Apple houdt wel even in de gaten of jij geen stoute dingen doet. Door die spyware op elk apparaat te gaan plaatsen ben je dan bij voorbaat verdachte. Dit staat 100% haaks op hun privacy beleid, ondanks de z.g. goede bedoelingen. Juist die wijziging van locatie maakt die keuze van Apple ongeloofwaardig.

Jerry

Inderdaad! Het is niet meer dan uitbreiding/verbetering van bestaande functionaliteit. Ik snap alle overdreven weerstand niet zo. Nuance is weer ver te zoeken. En als je er toch principieel op tegen bent, je hebt alles zelf in de hand: gebruik geen clouddiensten, maak geen foto’s met je phone of gebruik zelfs helemaal geen smart phone. Het is niet dat je gedwongen wordt op je privéleven in de cloud te bewaren

Henk

Privacy is ondergeschikt aan kinderporno

Mike

@Swen:

Beste Swen, ik raad jou graag aan dit stuk te lezen (Als iCulture de link toe staat);

https://edwardsnowden.substack.com/p/all-seeing-i