Apple legt uit hoe Siri in iOS 11 steeds menselijker wordt

Apple gebruikt machine learning om te zorgen dat de spraakassistent Siri een natuurlijke stem krijgt, sneller nieuwe talen leert en sneller begrijpt wat je bedoelt. Drie artikelen leggen uit hoe dat werkt.

Siri steeds slimmer dankzij machine learning

In iOS 11 krijgt Siri een aantal verbeteringen. Met een natuurlijker stem, meer keuze uit mannen- en vrouwenstemmen, realtime vertalingen en een behulpzamer assistent moet je als gebruiker de indruk krijgen dat er echte intelligentie in je iPhone zit. Die indruk is niet zo vreemd, want Apple gebruikt technieken uit de kunstmatige intelligentie om te zorgen dat Siri zich menselijker gedraagt. Ook wil Apple het gebruik analyseren, zodat Siri altijd het beste antwoord kan geven, soms nog voordat je de vraag hebt gesteld.

Siri is meer dan een stem: er gaat een hoop kunstmatige intelligentie schuil achter de antwoorden die je op het scherm krijgt. Hoe dat werkt? Kortgeleden ging Apple van start met een Machine Learning Journal, met wetenschappelijke artikelen over het onderzoek dat ze doen. In drie nieuwe artikelen legt Apple uit wat ze zoal hebben gedaan.

Het gaat om wetenschappelijke onderzoeken over deep learning-technieken, dus je moet wel even doorbijten. Het zijn onderwerpen die Apple later deze week zal bespreken op de conferentie Interspeech 2017 in Stockholm, Zweden.

Dit zijn de drie artikelen, waarbij we de technische termen omwille van de duidelijkheid Engelstalig hebben gelaten:

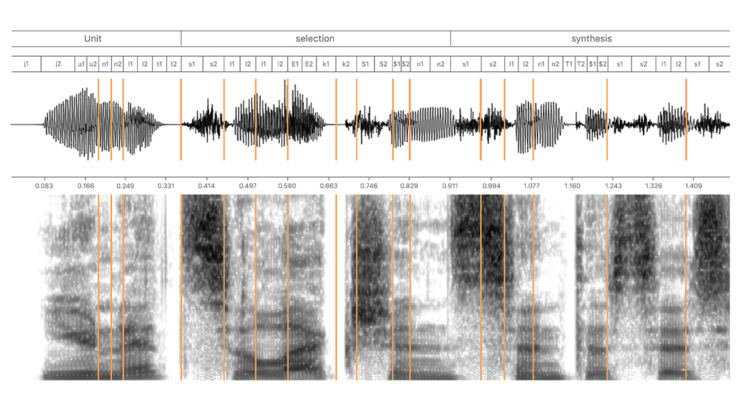

- Deep Learning for Siri’s Voice: vertelt hoe Apple deep mixture density networks op je toestel gebruikt voor hybrid unit selection synthesis.

- Inverse Text Normalization: legt uit hoe Siri datums, tijdstippen, adressen en valuta op een natuurlijke manier uitspreekt. Dit werkt ook andersom, dus een gesproken tekst “twaalf september tweeduizendzeventien” verschijnt op het scherm als “12 september 2017”.

- Improving Neural Network Acoustic Models: vertelt hoe Siri omgaat met variaties in taal, toestel, akoestische omgeving en bandbreedte van het communicatiekanaal en voor de gebruiker toch de indruk moet wekken dat de prestaties altijd hetzelfde zijn.

Je kunt in het eerstgenoemde bijvoorbeeld luisteren naar fragmenten van Siri in iOS 9, iOS 10 en iOS 11, waarin je duidelijk de verbetering van de stem hoort. Duidelijk is wel dat Apple steeds minder gebruik maakt van opgenomen woordjes, die door stemacteurs zijn ingesproken, maar dat er in iOS 11 kunstmatige stemmen worden gebruikt, waardoor de mogelijkheden veel flexibeler zijn. Bovendien gebruikt Siri kunstmatige leertechnieken om de intonatie, stemhoogte, klemtoon en het tempo realtime aan te passen terwijl er ook rekening wordt gehouden met de context.

Apple publiceert deze onderzoeken nadat ze eerder kritiek kregen dat de slimste mensen in het vakgebied niet bij Apple wilden werken, omdat het bedrijf zo gesloten is. Bij andere bedrijven mochten medewerkers wel hun werk publiceren en ervaringen uitwisselen met collega’s in het veld. Apple heeft sindsdien besloten om wat meer openheid te geven over de projecten waar ze mee bezig zijn. De onderzoekers op het gebied van machine learning, deep learning, neurale netwerken en andere vormen van kunstmatige intelligentie mogen sindsdien hun werk publiceren. De eerste publicatie ging over beeldherkenning en verscheen in juli.

Artikelcorrectie, spelfout of -aanvulling doorgeven?

Siri

25 reacties

Peter

Bij mij is Siri heel menselijk. Oostindisch doof namelijk! In mijn omgeving lukt het ook veel mensen niet om Siri tot activiteit te bewegen. Je zou denken dat ze leert om naar jouw vorm en uitspraak van hè Siri te luisteren, maar ho maar. Eerst een cursus hè Siri uitspreken volgen voordat je het kunt gebruiken!

P4Z

Classic: Big Bang Theory; Raj date Siri

Ricky

Hahhaha ik heb elke dag ruzie met siri precies om wat jij zegt. Ik heb opgemerkt dat siri niet activeert bij mij als de telefoon op zn kop staat, plat ligt scherm op tafel. En dat zijn juist de momenten waar ik dr nodig heb😒

Macaanzee

Hoezo “ze”? Bij mijn weten is Siri in Nederland nog altijd een man, die praat als een wat stijve gepensioneerde nieuwslezer. Hij heeft best humor, maar als het erop aan komt is hij toch niet slim genoeg om een behoorlijk antwoord te geven. En..als mijn zonen in huis zijn en mijn broer, slaat Siri aan op het ‘Hé Siri’ van vier verschillende personen… en dat kan toch niet de bedoeling zijn. Misschien dat Siri in Amerika slimmer is, maar hier komt hij nog niet aan basisschool niveau, met af en toe een leuk cynisch in woordgrapje, dat wel. Eerst maar ’s een leuke vrouwenstem voor Siri, in iOS 11, dat scheelt al heel wat 😜

Erik

Leuk, en interessante artikelen!

Ik gebruik Siri vooral voor afspraken en domotica en dat werkt prima, ook in combinatie met de Apple watch. Ik ben benieuwd naar de verbeterde Siri! Hopelijk gaat ze/hij Engelse termen (beter) begrijpen zodat ze ook als “vraagbaak” kan functioneren.

Luc

(Red.) Deze reactie is door een moderator verwijderd omdat deze niet aan onze reactierichtlijnen voldoet. Antwoorden op deze reactie zijn mogelijk ook verwijderd.

Thom

Lol! Je hebt het over Mark Rutte bedoel je:p vraag Siri maar eens wat en vertel me dan dat dat niet Rutte is xD

Elwin

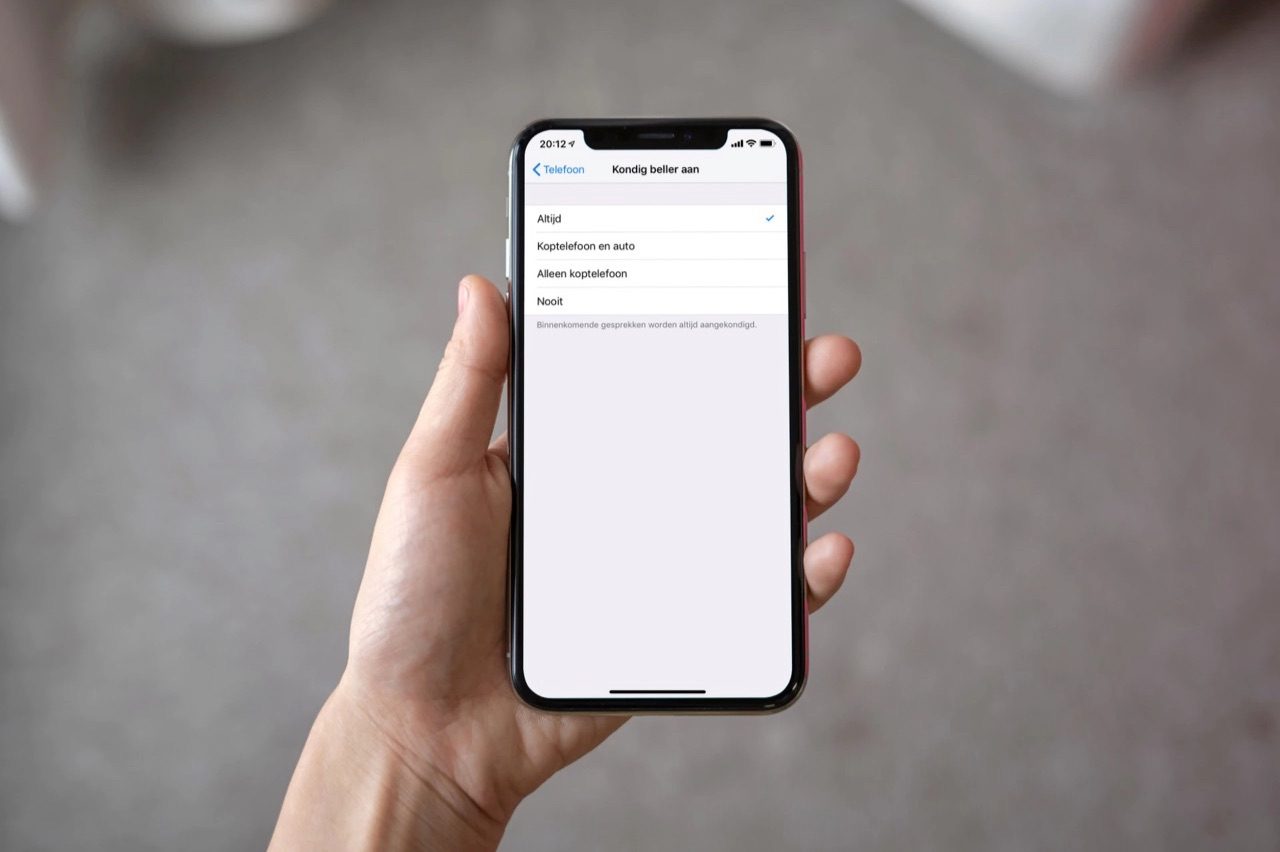

@Macaanzee: Siri is sinds de eerste beta van iOS 11 ook in te stellen op vrouwelijk.

Vincent

En dan komt het uit en dat is het nog dom, apple kan beter naar google kijken want daar blinken ze wel uit in de assistent als je het mij vraagt.

Ronald

Dat klopt, in de instellingen moet je Siri eerst configureren, zodat het ook goed werkt voor jou. (Dus een aantal keren ‘hé Siri’ uitspreken)

Hier geen problemen, gebruik het dagelijks voor de meest verschillende zaken.

Gabor

Het is in de beta van ios 11 een van de meest heugelijke verbeteringen.

Robenroute

Bovenstaande reacties zijn erg herkenbaar. Mijn grootste klacht is dat Siri mij in het Engels bijna niet verstaat. Nu ben ik tweetalig en spreek ik gewoon “native English”, en toch gaat het vaak verkeerd. Ik moet echt babytaal gaan spreken en de zaak enorm versimpelen om Siri er toe te bewegen in actie te komen. Het is om knettergek van te worden. Ik verwacht van een digitale assistent dat je er op een normale manier tegen kan praten.

Apple heeft nog een enorm lange weg te gaan.

eMilty

Oh? Bij mij is het nog steeds een man en heb ik geen keuze voor een vrouwenstem. De mannenstem klinkt wel anders (ik laat maar in het midden of het beter is).

Edit: Oh, huh? Na een keer gewisseld te hebben naar Belgie en weer terug naar Nederland is het nu wel opeens een vrouwenstem (met gewoon Nederlands accent, niet vlaams). Blijkbaar moet je even instellingen veranderen om een download te triggeren van nieuwe stembestanden.

Biscuit

Het is gewoon hopeloos, net maar weer eens geprobeerd, hard, zacht, het maakt niet uit ze begrijpt er geen moer van. Die hé siri functie kan er net zo goed uit.

MLVC

Bij mij verstaat Siri mij gewoon in het Engels (VS). Ik ben ook tweetalig, en Siri heeft absoluut geen enkele moeite om mij te verstaan.

Ad

Deze artikelen gaan (helaas) over stemverbeteringen wat betreft de US/UK variant. Lees het eerste artikel of scroll gelijk naar beneden, een wereld van verschil tussen iOS9 en iOS11!

Pim

Dat is een feature. Als je scherm naar beneden ligt luistert Siri niet mee.

Laurens

Hier ook een zeer actief Siri gebruiker, zowel op iPhone als op de Apple Watch. Misschien dat het 1 of 2 van de 100 keer niet direct goed gaat, maar al die andere keren werkt Siri bij mij perfect.

Wat ook al gezegd wordt; je moet wel ‘He Siri’ even goed configureren.

Donno

Hier ook regelmatig dat Siri wordt geactiveerd tijdens bv het kijken van een film. Uiteraard wordt er niet letterlijk om Siri gevraagd maar wel degelijk wordt ie geactiveerd.

Waar ik me nog het meest aan erger is dat je perse een bepaald format moet aanhouden.

Als je vraagt of het bv barbeque weer is dan reageert Siri met bbq’s en grills in je omgeving. Niet echt waar je om vroeg dus.

Luke

Ik heb als Brit / Nederlander ook geen probleem met Siri.

Wat ik wel jammer vind is dat je niet een bericht in een andere taal via Siri kunt dicteren, bijvoorbeeld: “Send Peter a message in Dutch. Hoi Peter, ik kom een kwartiertje later”. Of “Stuur Peter een Engels bericht, Hi Peter, I’ll be a quarter of an hour late”.

Gezien het iphone keyboard dicteer ding dit wel kan (door keyboard taal te switchen), is het eigenlijk raar dat Siri dit niet kan -zeker nu er live vertalingen mogelijk worden. Er zijn veel mensen die multitalig zijn (Belgen, Canadezen, Luxemburgers, etc).

De Apple Watch (allereerste versie) kon dit in het begin wel, maar enkele updates later verdween deze optie (was vast een bug haha)..

Dennis

Ik gebruik het echt nooit en mis er ook totaal niks aan, wel eens geprobeerd maar weer uitgezet.

Peter

Heb al een aantal keren Siri geconfigureerd en eindeloos hè Siri geroepen. Waardeloos is dat Apple wil dat ik leer hoe zij hè Siri uitspreken, terwijl ik wil dat m’n iPhone en iPad leren hoe ik het zeg! Als m’n iPhone leert hoe ik het zeg gaat ie ook niet actief worden als mijn vrouw hè siri roept,

TommyDiamond

Ik gebruik Siri dagelijks met nauwelijks problemen.

Oke, je moet de opdrachten kort en bondig houden maar het levert mij het gewenste resultaat op.

Ik zie Siri dan ook meer als een kwispelend huisdier dan een “menselijke” assistent, gewoon korte opdrachten and he works like a charm!

Het enige irritante is dat als ik een film kijk Siri ook nog wel eens meent te moeten reageren maar ach, dat doet mijn kwispelend huisdier ook met enige regelmaat..

Fabrice

Siri is nog altijd nutteloos voor complexe zinnen en opdrachten. Google assistent en zelfs bixby kunnen opvolgende opdrachten uitvoeren en andere apps bedienen..ben meer benieuwd naar de ontwikkeling van bixby dan siri.

Harry Loo

Wat vinden jullie van de nieuwe stem van Siri in IOS11? Ik vind het helemaal niks!